10分钟搞定,DeepSeek+Ollama+MaxKB 本地部署完全指南,打造专属知识库

在 AI 大模型蓬勃发展的当下,将模型进行本地部署,打造属于自己的专属知识库,既能保证数据隐私,又能灵活定制使用场景,已经成为众多技术爱好者和开发者的热门选择。今天,我们就来详细介绍如何在 10 分钟内完成 DeepSeek、Ollama 和 maxkb 的本地部署,搭建属于你的智能知识问答系统。

模型规模与性能权衡

小型模型(如1B-7B参数)

优势:推理速度快、部署成本低(CPU/低配GPU即可运行),适合高并发实时查询。

适用场景:简单QA检索、标准化问题解答、资源受限的中小企业。

中型模型(如13B-30B参数)

优势:在准确性和速度间取得平衡,支持多轮对话和中等复杂度推理。

适用场景:需处理行业术语、多条件查询的中型企业,适合云服务器或中端GPU部署。

大型模型(如70B+参数)

优势:理解深度强,支持复杂逻辑推理、长文档生成和专业领域适配。

适用场景:金融、医疗等专业领域的大型企业,需本地化部署(高端GPU集群)。

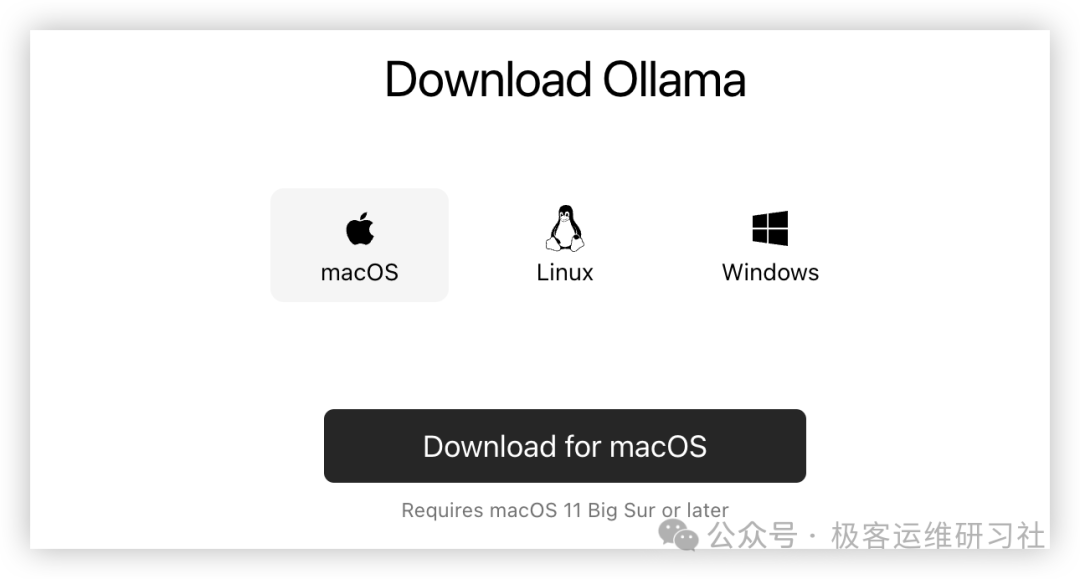

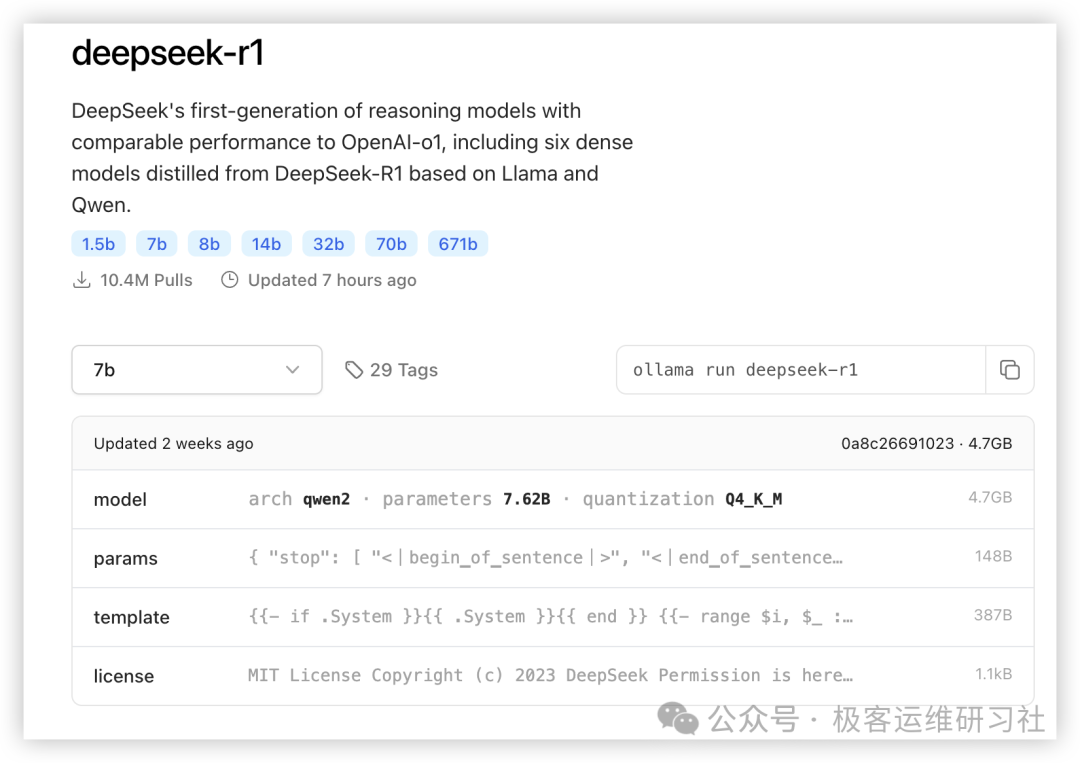

Ollama 本地部署 deepseek-r1

Ollama 是一个开源的大型语言模型服务工具,主要用于帮助用户快速在本地运行大模型。根据你使用的操作系统进行下载并安装。

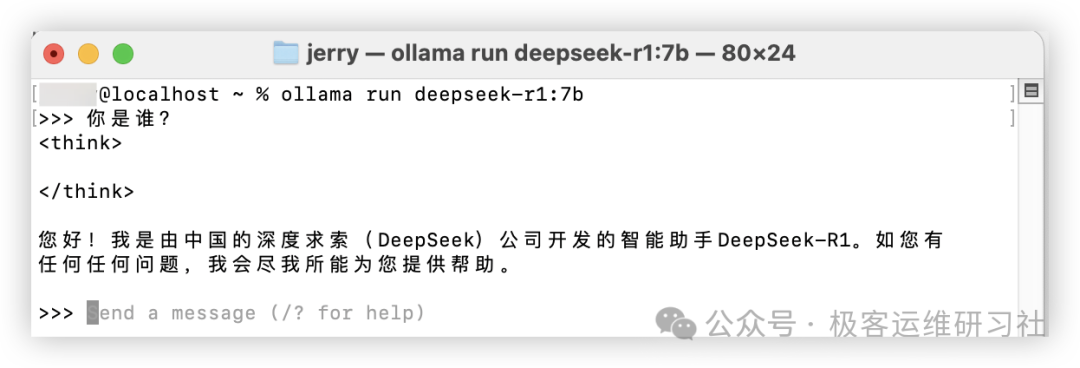

安装完成后,我们就可以通过一条命令来运行Deepseek-r1模型,本次我们使用的7b模型来做演示。

ollama run deepseek-r1

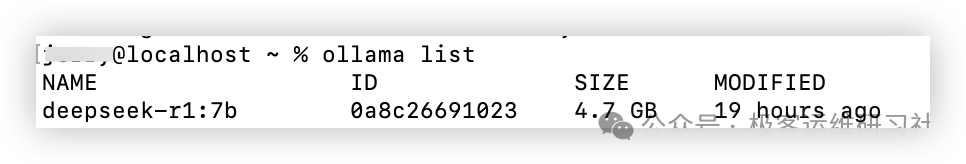

Ollama 常用命令

列出本地可用的模型列表:

ollama list

启动模型:

ollama run deepseek-r1:7b

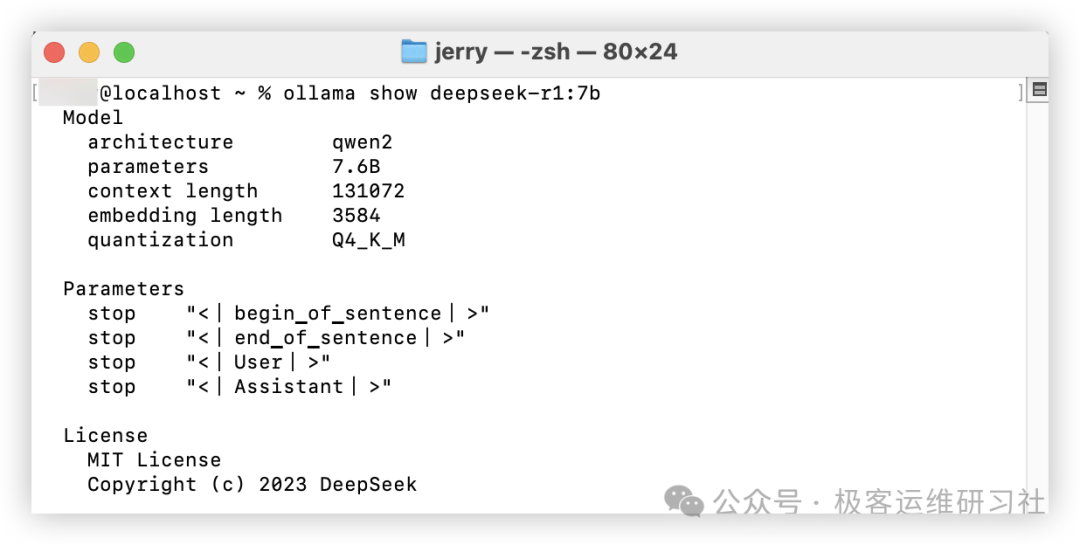

查看模型信息:

ollama show _model_name

删除指定模型

ollama rm deepseek-r1:7b

MaxKB 本地快速部署

MaxKB 即 Max Knowledge Base,是基于大语言模型与 RAG 的开源知识库问答系统,用于智能客服、企业内部知识库、学术研究与教育等场景。它专注知识库问答,为企业智能化 “提质增效”:能自动化知识采集、入库与知识库构建;解析问题、检索匹配知识库;用 LLM + RAG 技术减少大模型幻觉,提升业务数据分类召回能力;支持本地部署与本地大模型调用,管控安全风险。企业借助它可快速上线业务 AI 助手,赋能业务数据管理、资料查询、客户服务等,优化流程、提升体验。

通过Docker快速部署MaxKB

# Linux 操作系统

docker run -d --name=maxkb --restart=always -p 8080:8080 -v ~/.maxkb:/var/lib/postgresql/data -v ~/.python-packages:/opt/maxkb/app/sandbox/python-packages cr2.fit2cloud.com/1panel/maxkb

# Windows 操作系统

docker run -d --name=maxkb --restart=always -p 8080:8080 -v C:/maxkb:/var/lib/postgresql/data -v C:/python-packages:/opt/maxkb/app/sandbox/python-packages cr2.fit2cloud.com/1panel/maxkb待容器状态显示为healthy后,可通过浏览器访问 MaxKB:

http://目标服务器 IP 地址:8080

默认登录信息

✅ 用户名:admin

✅ 默认密码:MaxKB@123..

登录MaxKB,输入用户名、密码

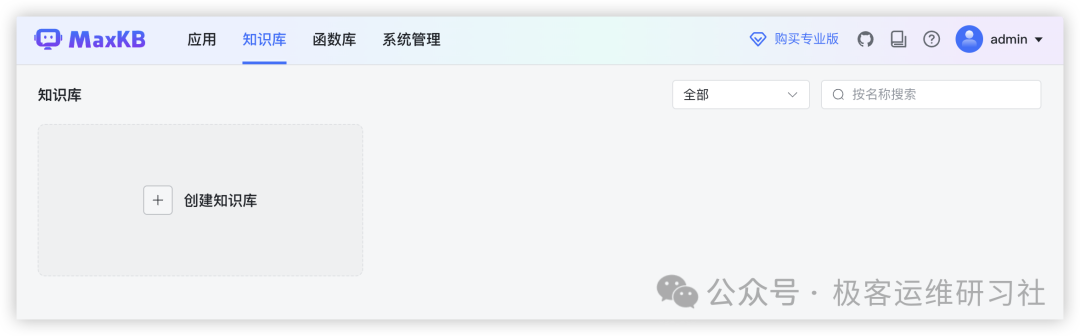

点击 知识库 ➡️ 创建知识库

输入知识库名称 、知识库描述 ➡️ 选择默认的 向量模型 ➡️ 知识库类型 默认选择 通用型 点击 创建

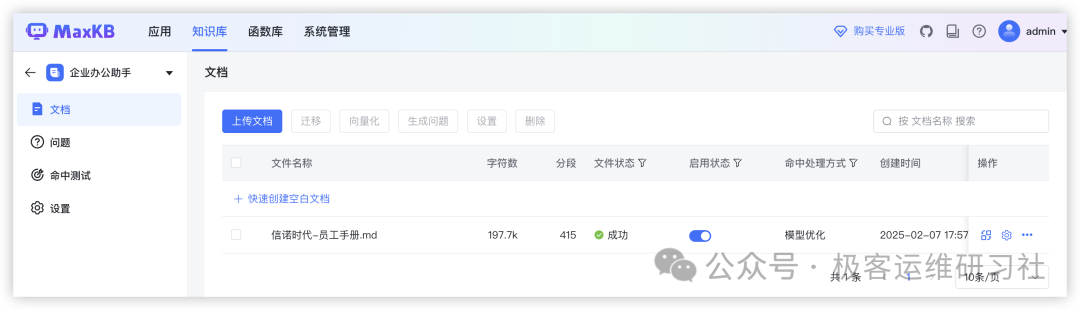

点击 上传文档 ,虽然MaxKB支持多种类型的文档,但还是建议使用Markdown格式的文档进行上传。

此处需要根据你上传的文档进行选择分段规则,如果默认智能分段比较清晰,可以使用默认智能分段。 点击 开始导入

等待向量化完成

向量化完成✅

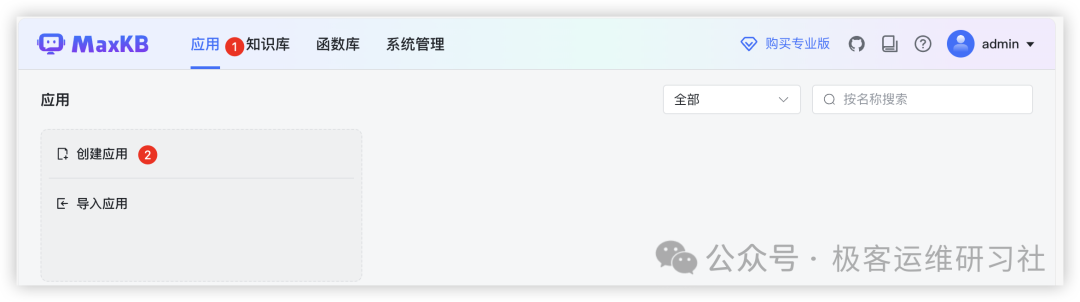

点击 应用 ➡️ 点击 创建应用

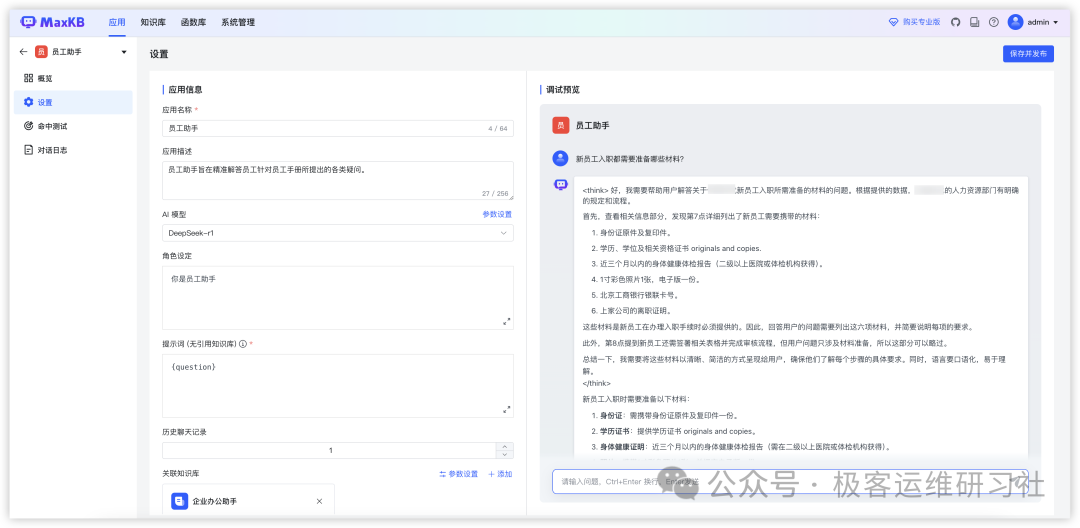

输入应用名称 、应用描述 、应用类型选择简单配置 即可。点击创建

创建完成后,点击AI模型 ,选择添加模型

添加Deepseek模型相关信息。

✅ 模型名称:DeepSeek-r1

✅权限:根据你的应用场景选择权限类型

✅模型类型:大语言模型

✅基础模型:此处需要手动输入deepseek-r1:7b

✅API域名:

输入http://host.docker.internal:11434

✅API Key:随意输入即可

找到 关联知识库 ,点击添加

选择刚刚创建的知识库进行关联,点击确认,对于开场白可以根据自己的实际场景进行设置。对于提示词可以暂时保持默认设置,后续根据需求场景进行有针对性调整。其中{data} 是引用知识库中已知信息,{question}是用户提出的问题。

当我们关联完知识库后,需要对点击 参数设置 对知识库做一些基础配置工作,当然这些配置大家要根据自己的实际情况去做调整,不要直接抄作业哈。

新员工入职都需要准备哪些材料?后AI会检索知识库并输出结果。确认调试没有问题后,点击右上角保存并发布

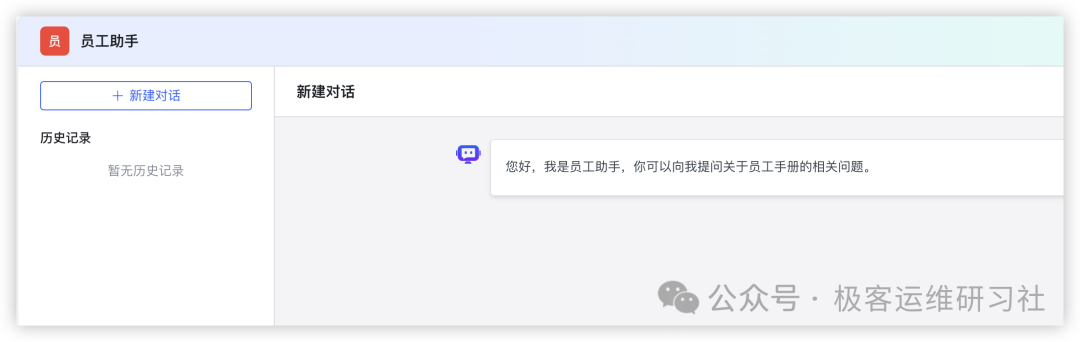

点击 概览 我们可以看到刚刚创建的 应用,点击演示可以直接跳转到我们应用助手的对话页面。

可以通过链接访问对话窗口页面,开始对话。

知识探索的征程才刚刚起步,咱们后会有期!

至此,DeepSeek + Ollama + MaxKB 的本地部署已然大功告成,属于你的专属知识库也已搭建完毕。大家依着这份指南一步步实操下来,是不是发现原来打造一个智能知识宝库也并非难事?倘若在操作过程中碰到了诸如模型下载卡顿、配置参数不匹配,又或是 MaxKB 应用交互异常之类的问题,千万别着急,只管在评论区畅所欲言,咱们一同攻坚克难。而且,如果各位还渴望深挖这些工具的更多奇妙用途,像是怎样利用它们进行多领域知识融合、如何进一步优化知识库的检索精准度,不妨动动手指点个赞,再留下你的期待,后续我们定会准备更多前沿、实用的干货分享,帮你在知识管理、智能应用的道路上一路飞驰,记得一定要持续关注我们哟!

本文链接:https://www.jingber.cn/post/3902.html 转载需授权!

微信扫一扫,打赏作者吧~

微信扫一扫,打赏作者吧~